Nota: (Clasificar las Artificial-Neuronal-Network (ANN) & (RNA); existen diferentes clasificaciones que separan las redes neuronales en torno a su número de capas, tipos de conexiones o grado de las conexiones. En su formas de hacer redes neuronales, basadas en algoritmos y desarrollos diversos. Lo haré de la siguiente forma por su Topologia y el tipo de Aprendizaje).

Clasificación-Artificial-Neuronal-Network

-. Artificial-Neuronal-Network (ANN) & (RNA) es un sistema de computación hecho por un gran número de elementos simples, elementos de proceso interconectados, los cuales procesan información por medio de su estado dinámico como respuesta a entradas externas (Hecht-Niesen, 1988) despues de esta definición pasemos a la clasificación por su Topologia.

Clasificación-Topologia:

La topología o arquitectura de una red consiste en la organización y disposición de las neuronas en la red. Las neuronas se agrupan formando capas, que pueden tener muy distintas características. Las capas se organizan para formar la estructura de la red.

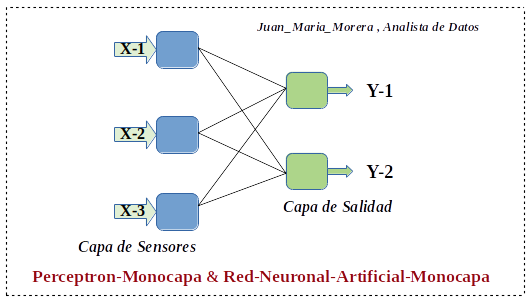

Perceptrón-Monocapa:

-. El más simple está compuesta por una capa de neuronas que proyectan las entradas a una capa de neuronas de salida donde se realizan los diferentes cálculos, es una red de alimentación directa, esto es la información fluye desde la capa de entrada hacia la capa de salida.

-. Arquitectura del Perceptron-Monocapa & Red-Neuronal-Artificial-Monocapa, es una red que consta de dos capas de neuronas. La función de la primera capa es hacer de sensor, por ella entran las señales a la red. La segunda capa realiza todo el procesamiento. La manera de interconexionar, la primera capa esta unida con todas las de la segunda capa.

-. En el ecosistema de Perceptrón-Monocapa & Red-Neuronal-Artificial-Monocapa, unidad básica de en forma de discriminador Linea, El Perceptrón-Monocapa pude utilizarse con otros tipos de Perceptrón-Monocapa & Red-Neuronal-Artificial-Monocapa para forman una Red Neuronal Artificial mas compleja.

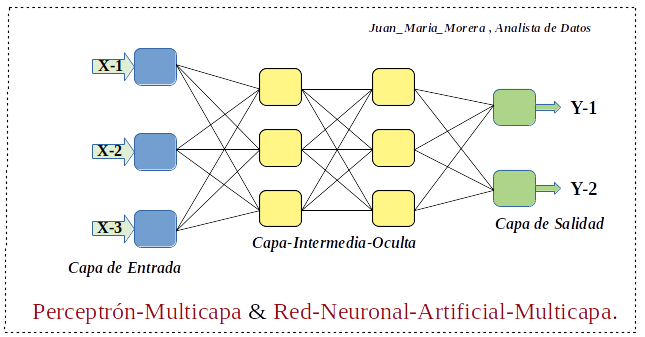

Perceptrón-Multicapa:

-.El Perceptrón-Multicapa es el proceso de unir Perceptrón-Monocapa para generar una Red-Neuronal-Artificial-Multicapa, la diferencia reside en que mientras la Red-Neuronal-Artificial-Monocapa está compuesta por una capa de neuronas de entrada y una capa de neuronas de salida, esta dispone de capas intermedias , capas ocultas entre la capa de entrada y la de salida, dependiendo del número de conexiones que presente la red esta seria otra posible forma Clasificación cono esta, puede estar total o parcialmente conectada.

-. El Perceptrón-Multicapa & Red-Neuronal-Artificial-Multicapa, consta de una capa de entrada y una capa de salida y una o más capas ocultas. Dichas capas se unen de forma total hacia delante, la capa entrada se une con la primera capa oculta y esta con la siguiente y la última capa oculta se une con la capa de salida. Los valores acepta son reales.

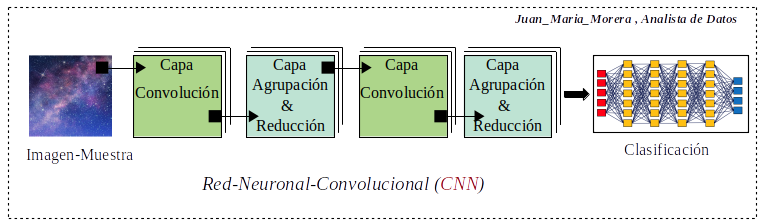

Red-Neuronal-Convolucional (CNN):

-. La diferencia de la Red-Neuronal-Convolucional con el Perceptrón-Multicapa es que cada neurona no se une con todas y cada una de las capas siguientes, lo que hace es que solo se une con un subgrupo de ellas, con esto se consigue reducir el número de neuronas necesarias y la complejidad computacional necesaria para su ejecución.

-. Otra diferencia de la Red-Neuronal-Convolucional respecto a otros tipos de Redes-Neuronales, es que diferentes partes de la Red-Neuronal, se pueden entrenar para tareas diversas. Con esto se consigue aumentar la velocidad de entrenamiento e identificar patrones de una forma más avanzada. Gracias al uso de Algoritmos para Redes-Convuncionales, se reduce el número de conexiones y de parámetros, por lo que requiere de menor entrenamiento. Algunos de los Algoritmos como sigmoide RLU, Maxout y Leaky ReLu.

-. Se crean de forma bidimensional, son muy efectivas para tareas de visión artificial, como en el caso de clasificar imágenes, reconocimiento de objetos, reconocimiento facial etc.

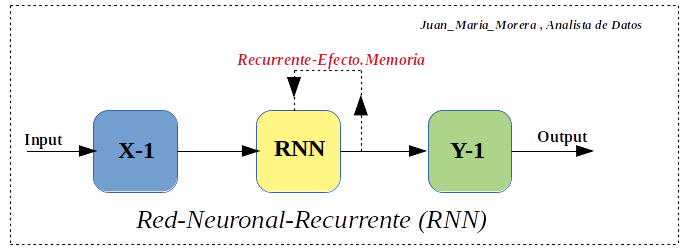

Red-Neuronal-Recurrente (RNN):

-. La Red-Neuronal-Recurrente no tienen una estructura de capas, sino que permiten conexiones arbitrarias entre las neuronas, incluso pudiendo crear ciclos, con esto se consigue crear la temporalidad, permitiendo que la red tenga memoria, es decir, que la información generada en iteraciones anteriores afecte al resultado del procesamiento en un tiempo futuro.

-. Las Red-Neuronal-Recurrente trabajan con datos secuenciales o de series temporales. Se utilizan para la traducción de idiomas, el procesamiento del lenguaje natural y el reconocimiento de voz. Es la base de aplicaciones como Google Translate o Siri.

Nota: Tenemos cuatro combinaciones de entrada/salida para RNN y cada una tiene una aplicación específica.

- Red-Neuronal-Recurrente; Uno a Uno.

- Red-Neuronal-Recurrente; Uno a Muchos.

- Red-Neuronal-Recurrente; Muchos a Uno.

- Red-Neuronal-Recurrente; Muchos a Muchos .

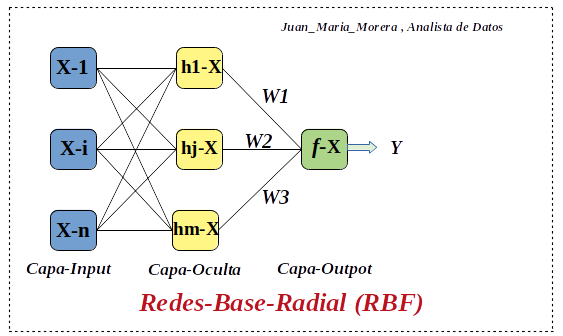

Redes-Base-Radial (RBF):

-. Las Redes-Base-Radial calculan la salida de la función en función de la distancia a un punto denominado centro. La salida es una combinación lineal de las funciones de activación radiales utilizadas por las neuronas individuales. Al igual que con los Perceptrones-Multicapa, sirven como Aproximadores-Universales, la Función-Base-Radial es una función que calcula la distancia euclidea de un vector de entrada respecto de un centro.

-. Arquitectura de una red de Función-Base-Radial. Un vector de entrada se utiliza como entrada para todas las funciones de base radial, cada una con diferentes parámetros. La salida de la red es una combinación lineal de las salidas de las Función-Base-Radial .

-. Redes-Base-Radial RBF es una Red-Neuronal-Artificial que utiliza funciones de base radial como funciones de activación. La salida de la red es una combinación lineal de funciones de base radial de las entradas y los parámetros de las neuronas. Las redes de funciones de base radial tienen muchos usos, incluida la aproximación de funciones , la predicción de series temporales , la clasificación y el control del sistema

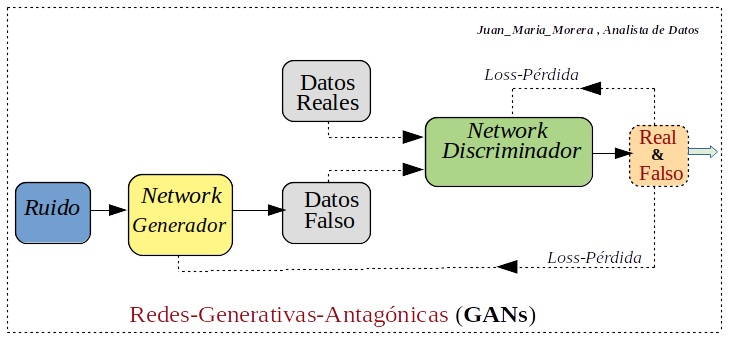

Red-Generativa-Antagónica (GAN):

. La Red-Generativa-Antagónica son arquitecturas algorítmicas que utilizan dos redes neuronales, enfrentando una contra la otra, el «adversario» para generar nuevas instancias sintéticas de datos que pueden pasar por datos reales. Se utilizan en la generación de imágenes.

. Redes-Generativas-Antagónicas (GANs),son una clase de algoritmos de inteligencia artificial que se utilizan en el aprendizaje no supervisado, implementadas por un sistema de dos redes neuronales que compiten mutuamente en una especie de juego de suma cero.

?Como funciona¿ Tenemos una Red-Neuronal, la cual llamamos Generador, genera nuevas instancias de datos, mientras que la otra, el Discriminador , los evalúa para verificar su autenticidad; es decir, el Discriminador decide si cada instancia de datos que revisa pertenece o no al conjunto de datos de entrenamiento real.

. En el diagrama tenemos la arquitectura general que tiene una GAN cómo el cálculo de la Loss de la clasificación interacciona entre las dos redes neuronales que intervienen. los datos reales que queremos que el Generador aprenda a emular lo mejor posible. Estos datos sirven de entrada a la red neuronal del Discriminador. Por otro lado, hay una entrada de datos aleatorios ruido que el Generador utiliza como punto de partida para sintetizar ejemplos. La red del Discriminador toma como entrada un dato real o un ejemplo falso producido por el Generador, y determina la probabilidad en una escala de 0 a 1 de que el ejemplo sea real. Finalmente, para cada una de las conjeturas del Discriminador se debe determinar cuán bueno fue, y usamos los resultados para ajustar iterativamente a través del mecanismo de backpropagation los parámetros de la red del Discriminador y de la red del Generador.

Clasificación-Redes-Según-Método-Aprendizaje :

. Las Redes ANN & RNA trabajan con dos tipos de información. La primera, es la información volátil, que se refiere a los datos que se están usando y varían con la computación de la red, se encuentra almacenada en el estado dinámico de las neuronas, el segundo tipo de información que manejan las redes neuronales, es la información no volátil que se mantiene para recordar los patrones aprendidos y se encuentra almacenada en los pesos sinápticos.

Aprendizaje-Supervisado en Redes-Neuronales:

-. Este tipo de clasificar las Redes ANN & RNA, se realiza mediante un entrenamiento controlado por un Supervisor que determina la respuesta que se debe generar para cada entrada, este Supervisor controla la salida y si no es correcta, modifica los Pesos, para conseguir que la salida se aproxime a la deseada.

-. Aprendizaje-Supervisado en Redes-Neuronales; en este metodo se muestran los patrones a la red y la salida deseada para esos patrones y se usa una fórmula matemática de minimización del error que ajuste los pesos para dar la salida más cercana posible a la salida deseada.

Nota: Tenemos una Redes-ANN & RNA-Supervisado-Estocástica: Es un tipo de red neuronal artificial caracterizada por la introducción de variaciones aleatorias en la red, bien sea mediante la asignación de funciones de transferencia estocásticas a las neuronas artificiales, o bien asignando un peso estocástico a cada neuronas, son útiles para resolver problemas de optimización, gracias a que las fluctuaciones aleatorias permiten al algoritmo escapar de los mínimos locales.

Aprendizaje no Supervisado en Redes-Neuronales:

-. Este tipo de clasificar las Redes ANN & RNA, no necesita que le introducir los patrones objetivo para la salida, el algoritmo y la regla de modificación de las conexiones producen patrones de salida consistentes.

Cuando la red procesa patrones con bastante grado de similitud, da la misma salida para ambos patrones, esto es, clasifica los patrones en categorías de patrones los cuales decidiremos en que grado deberán parecerse, se usa el Error-Cuadrático-Medio para determinar la similitud, existen otras opciones.

-. Aprendizaje no Supervisado en Redes-Neuronales usan representaciones modélicas de los objetos a reconocer y a clasificar. Una Aplicación-Reconocimiento-Facial, podríamos pasar la fotografía como un mapa de bits pero esto seria muy Costoso-Computacionalmente, si pasáramos una serie de valores como anchura de ojos, anchura de boca, etc., esto nos podría clasificar la cara en función de sus parecidos. con Costoso-Computacionalmente mucho mas bajo.

Aprendizaje por Refuerzo en Redes-Neuronales:

-. Este tipo de clasificar las Redes ANN & RNA, es un Aprendizaje por Refuerzo más lento que el Aprendizaje por Corrección de Errores, en este caso no se dispone de un conjunto completo de los datos exactos de salida sino que se le indica solamente si el dato es aceptable o no, con esto el algoritmo ajusta los pesos basándose en un mecanismo de probabilidades.

-. Aprendizaje por Refuerzo en Redes-Neuronales esta inspirada en la psicología conductista, cuya ocupación es determinar qué acciones debe escoger un agente de software en un entorno dado con el fin de maximizar alguna noción de recompensa o premio acumulado.

-. Su principal particularidad es que es capaz de funcionar sin grandes cantidades de datos de entrenamiento. Sólo necesita una serie de indicaciones para ir aprendiendo a través de prueba y error. Cuando se conoce cuál puede ser un paso adecuado para lograr un resultado deseado, pero se desconoce el camino completo para lograrlo, lo cual requiere mucha iteración.

Recopilando:

Esta clasificación de topología o arquitectura y Método-Aprendizaje son las que exploramos en este Post del cual se crearan otros Post mas en profundidad derivados de Clasificación-Artificial-Neuronal-Network .

- Referencias: Entorno-Moreluz

- Referencias: Para-saber-mas